Las tácticas descritas en la publicación se alinean con las redes de abuso sexual infantil en Discord que han sido eliminadas por las autoridades federales de EE. UU. en los últimos años. Los fiscales describieron redes con roles organizados, incluidos «cazadores» que ubicaban a niñas jóvenes y las invitaban a un servidor de Discord, «chateadores» que se encargaban de chatear con niñas y atraerlas, y «loopers» que transmitían contenido sexual previamente grabado y presentado como menores para alentar a los niños reales a participar en actividades sexuales

Shehan dijo que su organización recibe con frecuencia informes de otras plataformas tecnológicas que mencionan a los usuarios y el tráfico de Discord, lo que, según él, es una señal de que la plataforma se ha convertido en un centro de actividad ilícita.

Redgrave dijo: «Mi corazón está con las familias que se han visto afectadas por estos secuestros», y agregó que la preparación a menudo ocurre en muchas plataformas.

Redgrave dijo que Discord está trabajando con Thorn, un conocido desarrollador de tecnología contra la explotación infantil, en modelos que pueden detectar potencialmente el comportamiento de acicalamiento. Un representante de Thorn describió que el proyecto tiene el potencial de ayudar a «cualquier plataforma con un botón de descarga para detectar, investigar y denunciar MASI y otras formas de abuso sexual infantil en Internet». Actualmente, las plataformas pueden detectar imágenes y videos ya identificados como MASI, pero tienen dificultades para detectar contenido nuevo o comportamientos de preparación a largo plazo.

Aunque el problema ha existido durante años, NBC News, en colaboración con el investigador Matt Richardson de la Iniciativa de inteligencia contra la trata de personas, una organización sin fines de lucro con sede en EE. UU., pudo ubicar fácilmente los servidores existentes que mostraban signos evidentes de uso para la explotación infantil.

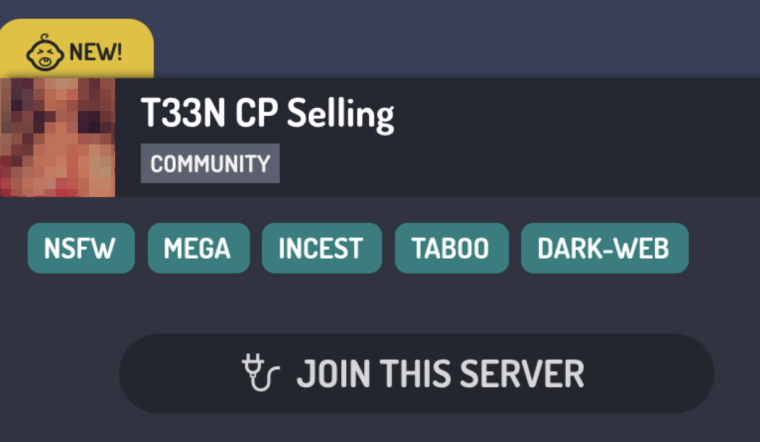

En los sitios web dedicados a enumerar los servidores de Discord, las personas promocionaron sus servidores usando variaciones de palabras con las iniciales «CP», abreviatura de pornografía infantil, como «queso-pizza» y «política relajada». Las descripciones de los grupos a menudo eran más explícitas y anunciaban la venta de «t33n» o contenido para adolescentes. Discord no opera estos sitios web.

En respuesta a las preguntas de NBC News sobre los servidores de Discord, Redgrave dijo que la compañía está tratando de educar a los sitios web de terceros que los promocionan sobre los pasos que podrían tomar para proteger a los niños.

En varios servidores, los grupos han solicitado explícitamente a los menores que se unan a comunidades “inseguras para el trabajo”. Un servidor se promocionó a sí mismo en una base de datos de servidores públicos y dijo: “Esta es una comunidad para personas de 13 a 17 años. Intercambiamos desnudos, hacemos eventos. Únase a nosotros para la mejor experiencia Teen-NSFW <3”.

Los grupos parecen ajustarse a la descripción de grupos que producen material de explotación sexual infantil descrita por los fiscales, donde los adultos fingen ser adolescentes para engañar a niños reales para que compartan imágenes de desnudos.

En uno de los grupos, los usuarios solicitaban directamente imágenes de desnudos de menores para acceder. «¡DEBE ENVIAR UNA FOTO DE VERIFICACIÓN AL DUEÑO! DEBE ESTAR DESNUDO”, escribió un usuario en el grupo. «SOLO ACEPTAMOS EDADES DE 12 A 17 AÑOS».

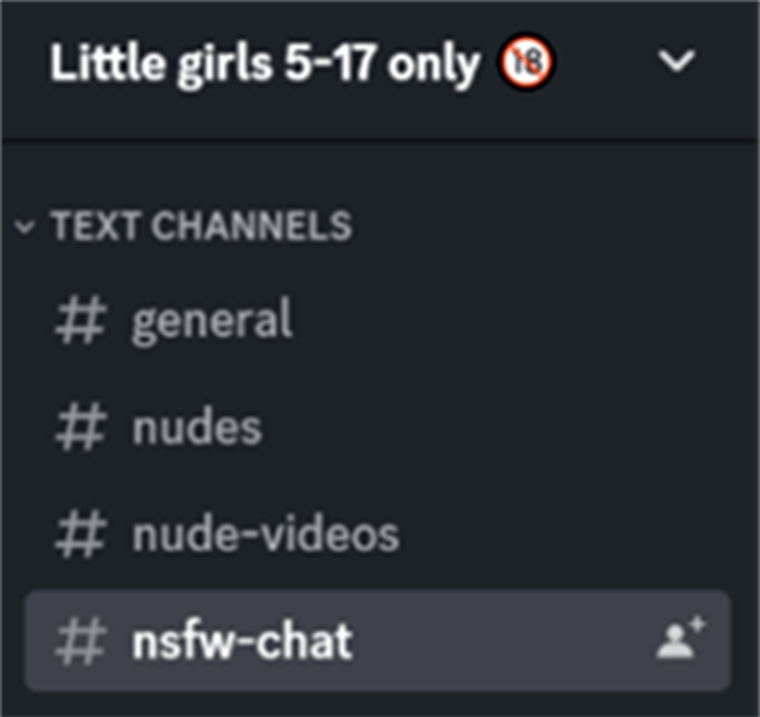

En otro grupo, que afirmaba específicamente que solo aceptaba «niñas de 5 a 17 años», los canales de chat incluían los títulos «chats de súplicas sexuales», «chat de mensajes de texto con el propietario del servidor», «chats desnudos». videos» y «desnudos».

Richardson dijo que estaba trabajando con las fuerzas del orden público para investigar un grupo en Discord con cientos de miembros que celebran abiertamente la extorsión de niños a los que dicen engañar para que compartan imágenes sexuales, incluidas imágenes de autolesiones y videos que dicen «Tuve la niños grabados.

NBC News no ingresó a los canales y el material de abuso sexual infantil no se vio en el reportaje de este artículo.

Discord se vende a niños y adolescentes, publicitando su función para clubes escolares en su página de inicio. Pero muchos otros usuarios de la plataforma son adultos. Ambos grupos de edad pueden mezclarse libremente. Algunas otras plataformas, como instagramhan instituido restricciones sobre cómo las personas menores de 18 años pueden interactuar con personas mayores de 18 años.

La plataforma permite que cualquier persona cree una cuenta y, al igual que otras plataformas, solo solicita una dirección de correo electrónico y una fecha de nacimiento. Discordia Estrategias dice que los usuarios de EE. UU. no pueden unirse a menos que tengan al menos 13 años, pero no tiene un sistema para verificar la edad autoinformada de un usuario. La verificación de la edad se ha convertido en un tema candente en el mundo de la política de las redes sociales, ya que se está considerando una legislación sobre el tema en los Estados Unidos. Certaines grandes plates-formes telles que Meta ont tenté d’instituer leurs propres méthodes de vérification de l’âge, et Discord n’est pas la seule plate-forme qui n’a pas encore mis en place un système de vérification de l’ edad.

Redgrave dijo que la compañía está «investigando muy activamente e invertirá en tecnologías de garantía de la edad».

Los niños menores de 13 años son frecuentemente capaz de hacer cuentas en la aplicación, dice la corte presentaciones revisadas por NBC News.

A pesar de la naturaleza cerrada de la plataforma y la edad media mixta, la plataforma ha sido transparente sobre su falta de supervisión de las actividades que se llevan a cabo allí.

«No monitoreamos cada servidor o cada conversación», dijo la plataforma en una página de su centro de Seguridad. En cambio, la plataforma dice que espera principalmente a que los miembros de la comunidad informen los problemas. «Cuando somos alertados de un problema, investigamos el comportamiento involucrado y tomamos medidas».

Redgrave dijo que la compañía está probando modelos que analizan los metadatos del servidor y del usuario en un esfuerzo por detectar amenazas a la seguridad de los niños.

Redgrave dijo que la compañía planea lanzar nuevos modelos que intentarán localizar tendencias no descubiertas en contenido de explotación infantil a finales de este año.

A pesar de los esfuerzos de Discord para abordar la explotación infantil y el MASI en su plataforma, muchos supervisores y funcionarios dijeron que se podía hacer más.

Denton Howard, director ejecutivo de Inhope, una organización de líneas directas para niños desaparecidos y explotados en todo el mundo, dijo que los problemas de Discord se derivan de una falta de previsión, similar a la de otras empresas.

“La seguridad por diseño debe incluirse desde el primer día, no desde el día 100”, dijo.

Howard dijo que Discord se acercó a Inhope y se ofreció a ser un socio donante para la organización. Después de una evaluación de riesgos y una consulta con los miembros del grupo, Inhope rechazó la oferta y destacó las áreas de mejora de Discord, que incluían tiempos de respuesta lentos a los informes, problemas de comunicación cuando las líneas directas intentaban unirse, líneas directas que recibían advertencias de cuenta cuando intentaban denunciar CSAM, alojamiento continuo de comunidades que comercian y crean CSAM, y la evidencia desaparece antes de escuchar a Discord.

En un correo electrónico de Discord a Inhope visto por NBC News, Discord dijo que la compañía estaba actualizando sus políticas con respecto a la seguridad infantil y trabajando para implementar el «Clasificador de aseo personal de THORN».

Howard dijo que Discord ha progresado desde ese intercambio de marzo, restableciendo el programa que prioriza los informes de las líneas directas, pero Inhope aún no ha aceptado la donación de la compañía.

Redgrave dijo que cree que las mejoras recomendadas por Inhope están alineadas con los cambios que la compañía ha esperado implementar durante mucho tiempo.

Shehan señaló que el NCMEC también ha tenido dificultades para trabajar con Discord, y dijo que la organización rescindió una invitación para que Discord fuera parte de su mesa redonda Cybertipline, que incluye policías y destacados periodistas de todo el mundo. un representante senior de seguridad infantil». participar.»

«Fue realmente cuestionable, su compromiso con lo que están haciendo en el frente de la explotación infantil», dijo Shehan.

Sargento Primero de Detectives. Tim Brown, de la Policía Provincial de Ontario de Canadá, dijo que recientemente también recibió una respuesta irritante de la plataforma que lo llevó a cuestionar las prácticas de seguridad infantil de la compañía. En abril, Brown dijo que Discord le pidió a su departamento que pagara después de pedirle a la compañía que conservara los registros relacionados con un círculo de contenido sospechoso de abuso sexual infantil.

Brown dijo que su departamento identificó un servidor Discord con 120 participantes que compartían material de abuso sexual infantil. Cuando la policía le pidió a Discord que mantuviera los registros para su investigación, Discord sugirió que costaría una cantidad de dinero no especificada.

En un correo electrónico de Discord a la Policía de Ontario visto por NBC News, el equipo legal de Discord escribió: «La cantidad de cuentas que ha solicitado en su retención es demasiado grande para que Discord pueda acceder fácilmente a ellas. Sería demasiado engorroso buscar o recuperar datos que pudieran existir. Si continúa pidiéndole a Discord que investigue y produzca esta información, primero tendremos que discutir el reembolso de los costos asociados con la investigación y producción de más de 20 identificadores.

Brown dijo que nunca antes había visto a otra compañía de redes sociales pedir un reembolso por tener evidencia potencial.

Brown dijo que su departamento finalmente presentó solicitudes individuales para cada identificación, que fueron aceptadas por Discord sin pago, pero el proceso tomó tiempo en otras partes de la investigación.

“Definitivamente puso un obstáculo”, dijo.

Redgrave dijo que la compañía solicita de manera rutinaria a las fuerzas del orden público que reduzcan el alcance de las solicitudes de información, pero la solicitud de pago fue un error: «No es parte de nuestro proceso de respuesta».